В данной статье кратко описана история развития некоторых идей и воззрений в математике, которые внесли свой особый вклад в современное представление об искусственном интеллекте. Здесь описан лишь небольшой круг людей, событий и открытий, поэтому не стоит считать эту статью полной всеобъемлющей. Математика (период примерно с 800 года по настоящее время) позволяет ответить на следующие фундаментальные вопросы:

- Каковы формальные правила формирования правильных заключений?

- Как определить пределы вычислимости?

- Как проводить рассуждения с использованием недостоверной информации?

Философы сформулировали наиболее важные идеи искусственного интеллекта, но для преобразования его в формальную науку потребовалось достичь определенного уровня математической формализации в трех фундаментальных областях:

- логика,

- вычисления и

- вероятность.

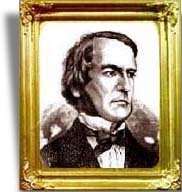

Истоки идей формальной логики можно найти в работах философов древней Греции, но ее становление как математической дисциплины фактически началась с трудов Джорджа Буля (1815-1864), который детально разработал логику высказываний, или булеву логику.

Истоки идей формальной логики можно найти в работах философов древней Греции, но ее становление как математической дисциплины фактически началась с трудов Джорджа Буля (1815-1864), который детально разработал логику высказываний, или булеву логику.

В 1879 году Готтлоб Фреге (1848-1925) расширил булеву логику для включения в нее объектов и отношений, создав логику первого порядка, которая в настоящее время используется как наиболее фундаментальная система представления знаний (предложенная Готтлобом Фреге система обозначений для логики первого порядка так и не нашла широкого распространения).

Альфред Тарский (1902—1983) впервые ввел в научный обиход теорию ссылок, которая показывает, как связать логические объекты с объектами реального мира. Следующий этап состоял в определении пределов того, что может быть сделано с помощью логики и вычислений.

Первым нетривиальным алгоритмом считается алгоритм вычисления наибольшего общего знаменателя, предложенный Евклидом. Исследование алгоритмов как самостоятельных объектов было начато аль-Хорезми, среднеазиатским математиком IX столетия, благодаря работам которого Европа познакомилась с арабскими цифрами и алгеброй.

Буль и другие ученые широко обсуждали алгоритмы логического вывода, а к концу XIX столетия уже предпринимались усилия по формализации общих принципов проведения математических рассуждений как логического вывода.

В 1900 году Давид Гильберт (1862—1943) представил список из 23 проблем и правильно предсказал, что эти проблемы будут занимать математиков почти до конца XX века. Последняя из этих проблем представляет собой вопрос о том, существует ли алгоритм для определения истинности любого логического высказывания, в

состав которого входят натуральные числа. Это — так называемая знаменитая проблема поиска решения (Entscheidungsproblem). По сути, этот вопрос, заданный Гильбертом, сводился к определению того, есть ли фундаментальные пределы, ограничивающие мощь эффективных процедур доказательства.

В 1930 году Курт Гёдель (1906—1978) показал, что существует эффективная процедура доказательства любого истинного высказывания в логике первого порядка Фреге и Рассела, но при этом логика первого порядка не позволяет выразить принцип математической индукции, необходимый для представления натуральных чисел.

В 1931 году Гёдель показал, что действительно существуют реальные пределы вычислимости. Предложенная им теорема о неполноте показывает, что в любом языке, достаточно выразительном для описания свойств натуральных чисел, существуют истинные высказывания, которые являются недоказуемыми, в том смысле, что их истинность невозможно установить с помощью какого-либо алгоритма.

Этот фундаментальный результат может также рассматриваться как демонстрация того, что имеются некоторые функции от целых чисел, которые не могут быть представлены с помощью какого-либо алгоритма, т.е. они не могут быть вычислены.

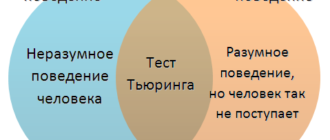

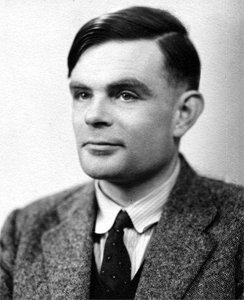

Это побудило Алана Тьюринга (1912-1954) попытаться точно охарактеризовать, какие функции способны быть вычисленными. Этот подход фактически немного проблематичен, поскольку в действительности понятию вычисления, или эффективной процедуры вычисления, не может быть дано формальное определение. Но

Это побудило Алана Тьюринга (1912-1954) попытаться точно охарактеризовать, какие функции способны быть вычисленными. Этот подход фактически немного проблематичен, поскольку в действительности понятию вычисления, или эффективной процедуры вычисления, не может быть дано формальное определение. Но

общепризнано, что вполне удовлетворительное определение дано в тезисе Чёрча—Тьюринга, который указывает, что машина Тьюринга способна вычислить любую вычислимую функцию. Кроме того, Тьюринг показал, что существуют некоторые функции, которые не могут быть вычислены машиной Тьюринга. Например, вообще говоря, ни одна машина не способна определить, возвратит ли данная конкретная программа ответ на конкретные входные данные или будет работать до бесконечности.

Хотя для понимания возможностей вычисления очень важны понятия недоказуемости и невычислимости, гораздо большее влияние на развитие искусственного интеллекта оказало понятие неразрешимости.

Грубо говоря, задача называется неразрешимой, если время, требуемое для решения отдельных экземпляров этой задачи, растет экспоненциально с увеличением размеров этих экземпляров.

Различие между полиномиальным и экспоненциальным ростом сложности было впервые подчеркнуто в середине 1960-х годов в работах Кобхэма и Эдмондса.

Важность этого открытия состоит в следующем: экспоненциальный рост означает, что даже экземпляры задачи умеренной величины не могут быть решены за какое-либо приемлемое время. Поэтому, например, приходится заниматься разделением общей задачи выработки интеллектуального поведения на разрешимые подзадачи, а не пытаться решать неразрешимую задачу.

Как можно распознать неразрешимую проблему? Один из приемлемых методов такого распознавания представлен в виде теории NP-полноты, впервые

предложенной Стивеном Куком и Ричардом Карпом. Кук и Карп показали, что существуют большие классы канонических задач комбинаторного поиска и формирования рассуждений, которые являются NP-полными. Существует вероятность того, что любой класс задач, к которому сводится этот класс NP-полных задач, является неразрешимым. (Хотя еще не было доказано, что NP-полные задачи обязательно являются неразрешимыми, большинство теоретиков считают, что дело обстоит именно так.) Эти результаты контрастируют с тем оптимизмом, с которым в популярных периодических изданиях приветствовалось появление первых компьютеров под такими заголовками, как «Электронные супермозги», которые думают «быстрее Эйнштейна!» Несмотря на постоянное повышение быстродействия компьютеров, характерной особенностью интеллектуальных систем является экономное использование ресурсов.

Грубо говоря, наш мир, в котором должны освоиться системы ИИ, — это чрезвычайно крупный экземпляр задачи. В последние годы методы искусственного интеллекта помогли разобраться в том, почему некоторые экземпляры NP-полных задач являются сложными, а другие простыми.

Кроме логики и теории вычислений, третий по величине вклад математиков в искусственный интеллект состоял в разработке теории вероятностей.

Идея вероятности была впервые сформулирована итальянским математиком Джероламо Кардано (1501—1576), который описал ее в терминах результатов событий с несколькими исходами, возникающих в азартных играх. Теория вероятностей быстро стала неотъемлемой частью всех количественных наук, помогая использовать

недостоверные результаты измерений и неполные теории.

Пьер Ферма (1601 —1665), Блез Паскаль (1623-1662), Джеймс Бернулли (1654-1705), Пьер Лаплас (1749—1827) и другие ученые внесли большой вклад в эту теорию и ввели новые статистические методы.

Томас Байес (1702—1761) предложил правило обновления вероятностей с учетом новых фактов. Правило Байеса и возникшее на его основе научное направление, называемое байесовским анализом, лежат в основе большинства современных подходов к проведению рассуждений с учетом неопределенности в системах искусственного интеллекта.

Томас Байес (1702—1761) предложил правило обновления вероятностей с учетом новых фактов. Правило Байеса и возникшее на его основе научное направление, называемое байесовским анализом, лежат в основе большинства современных подходов к проведению рассуждений с учетом неопределенности в системах искусственного интеллекта.

По материалам книги – Artificial Intelligence — A Modern Approach (Prentice Hall, 3rd edition) Russell S.J., Norvig P.